DeepSeek mHC: تثبيت التدريب على نماذج اللغات الكبيرة

تتوسع نماذج الذكاء الاصطناعي الكبيرة بسرعة، حيث أصبحت البنى الأكبر وعمليات التدريب الأطول هي القاعدة. ومع نمو النماذج، ظلت مشكلة استقرار التدريب الأساسية دون حل. يعالج DeepSeek mHC هذه المشكلة مباشرة من خلال إعادة التفكير في كيفية تصرف الاتصالات المتبقية على نطاق واسع. تشرح هذه المقالة DeepSeek mHC (الاتصالات الفائقة المقيدة المتعددة) وتوضح كيف تعمل على تحسين استقرار وأداء التدريب على نماذج اللغة الكبيرة دون إضافة تعقيدات معمارية غير ضرورية.

المشكلة الخفية مع الاتصالات المتبقية والمفرطة

لقد كانت الاتصالات المتبقية بمثابة لبنة أساسية في التعلم العميق منذ إصدار ResNet في عام 2016. فهي تسمح للشبكات بإنشاء مسارات مختصرة، مما يتيح تدفق المعلومات مباشرة عبر الطبقات بدلاً من إعادة تعلمها في كل خطوة. بعبارات بسيطة، تعمل مثل الممرات السريعة في الطريق السريع، مما يجعل تدريب الشبكات العميقة أسهل.

وقد نجح هذا النهج لسنوات عديدة. ولكن مع تطور النماذج من الملايين إلى المليارات، والآن مئات المليارات من المعلمات، أصبحت حدودها واضحة. ولدفع الأداء إلى أبعد من ذلك، قدم الباحثون تقنية Hyper-Connections (HC)، مما أدى إلى توسيع هذه الطرق السريعة للمعلومات بشكل فعال عن طريق إضافة المزيد من المسارات. تحسن الأداء بشكل ملحوظ، لكن الاستقرار لم يتحسن.

أصبح التدريب غير مستقر للغاية. سوف تتدرب النماذج بشكل طبيعي ثم تنهار فجأة حول خطوة معينة، مع ارتفاع حاد في الخسارة وتدرجات متفجرة. بالنسبة للفرق التي تقوم بتدريب نماذج لغوية كبيرة، قد يعني هذا النوع من الفشل إهدار كميات هائلة من الحوسبة والوقت والموارد.

ما هي الاتصالات المفرطة المقيدة المتعددة (mHC)؟

إنه إطار عام يعين مساحة الاتصال المتبقية لـ HC إلى مشعب معين لتعزيز خاصية رسم خرائط الهوية، وفي الوقت نفسه يتضمن تحسينًا صارمًا للبنية التحتية ليكون فعالاً.

تظهر الاختبارات التجريبية أن MHC جيد للتدريب واسع النطاق، ولا يوفر مكاسب واضحة في الأداء فحسب، بل يوفر أيضًا قابلية توسعة ممتازة. نتوقع أن يكون mHC، إضافة متعددة الاستخدامات ويمكن الوصول إليها إلى HC، للمساعدة في فهم تصميم الهندسة المعمارية الطوبولوجية واقتراح مسارات جديدة لتطوير النماذج التأسيسية.

ما الذي يجعل mHC مختلفًا؟

إن استراتيجية DeepSeek ليست ذكية فحسب، بل إنها رائعة لأنها تجعلك تفكر “أوه، لماذا لم يفكر أحد في هذا من قبل؟” لقد احتفظوا بالاتصالات الفائقة ولكنهم حددوها بطريقة رياضية دقيقة.

هذا هو الجزء الفني (لا تتخلى عني، فالأمر يستحق أن تفهمه): تسمح الاتصالات المتبقية القياسية بتنفيذ ما يعرف باسم “رسم خرائط الهوية”. تصور الأمر على أنه قانون حفظ الطاقة حيث تنتقل الإشارات عبر الشبكة بنفس مستوى الطاقة. عندما قامت HC بزيادة عرض التدفق المتبقي ودمجه مع أنماط الاتصال القابلة للتعلم، فقد انتهكت هذه الخاصية عن غير قصد.

لقد أدرك باحثو DeepSeek أن التعيينات المركبة لـ HC، بشكل أساسي، عندما تستمر في تكديس هذه الاتصالات طبقة بعد طبقة، كانت تعزز الإشارات بمضاعفات 3000 مرة أو حتى أكثر. تخيل أنك تجري حوارًا وفي كل مرة يقوم شخص ما بتوصيل رسالتك، فإن الغرفة بأكملها تصرخ بصوت أعلى 3000 مرة. وهذا ليس سوى الفوضى.

يحل mHC المشكلة عن طريق إسقاط مصفوفات الاتصال هذه على متعدد Birkhoff، وهو كائن هندسي مجرد يكون فيه مجموع كل صف وعمود يساوي 1. قد يبدو الأمر نظريًا، لكنه في الواقع، يجعل الشبكة تتعامل مع انتشار الإشارة كمجموعة محدبة من الميزات. لا مزيد من الانفجارات، لا مزيد من الإشارات تختفي تمامًا.

الهندسة المعمارية: كيف يعمل mHC فعليًا

دعنا نستكشف تفاصيل كيفية تغيير DeepSeek للاتصالات داخل النموذج. ويعتمد التصميم على ثلاثة مخططات رئيسية تحدد اتجاه المعلومات:

نظام الخرائط الثلاثية

في Hyper-Connections، تؤدي ثلاث مصفوفات قابلة للتعلم مهام مختلفة:

- ح_ل: يأخذ المعلومات من الدفق المتبقي الممتد إلى الطبقة

- ح_بوست: يرسل إخراج الطبقة مرة أخرى إلى الدفق

- ح_ريس: يجمع ويحدث المعلومات في الدفق نفسه

تصوره كنظام طرق سريعة حيث H_pre هو منحدر المدخل، وH_post هو منحدر الخروج، وH_res هو مدير تدفق حركة المرور بين الممرات.

إحدى نتائج دراسات الاجتثاث التي أجراها DeepSeek مثيرة للاهتمام للغاية – H_res (التخطيط المطبق على البقايا) هو المساهم الرئيسي في زيادة الأداء. لقد قاموا بإيقاف تشغيله، ولم يسمحوا إلا بالتعيينات المسبقة واللاحقة، وانخفض الأداء بشكل كبير. وهذا أمر منطقي: أهم ما يميز العملية هو عندما تتفاعل الميزات من أعماق مختلفة وتتبادل المعلومات.

القيد المنوع

هذه هي النقطة التي يبدأ فيها MHC بالانحراف عن HC العادي. بدلًا من السماح بانتقاء H_res بشكل تعسفي، فرضوا أنها عشوائية مضاعفة، وهي خاصية يجمعها كل صف وكل عمود في 1.

ما أهمية هذا؟ هناك ثلاثة أسباب رئيسية:

- يتم الحفاظ على القواعد سليمة: يتم الاحتفاظ بالمعيار الطيفي ضمن حدود 1، وبالتالي لا يمكن أن تنفجر التدرجات.

- الإغلاق تحت التكوين: يؤدي مضاعفة المصفوفات العشوائية المضاعفة إلى ظهور مصفوفة عشوائية مضاعفة أخرى؛ ومن ثم، فإن عمق الشبكة بالكامل لا يزال مستقرًا.

- رسم توضيحي من حيث الهندسة: المصفوفات موجودة في بوليتوب بيركوف، وهو الهيكل المحدب لجميع مصفوفات التقليب. وبعبارة أخرى، تتعلم الشبكة مجموعات مرجحة من أنماط التوجيه حيث تتدفق المعلومات بشكل مختلف.

خوارزمية Sinkhorn-Knopp هي التي تستخدم لفرض هذا القيد، وهي طريقة تكرارية تحافظ على تسوية الصفوف والأعمدة بالتناوب حتى يتم الوصول إلى الدقة المطلوبة. في التجارب، ثبت أن 20 تكرارًا تسفر عن تقريب مناسب بدون حسابات مفرطة.

تفاصيل المعلمة

التنفيذ ذكي. بدلاً من العمل على ناقلات ميزة واحدة، يقوم mHC بضغط مصفوفة n×C المخفية بالكامل في متجه واحد. يسمح هذا باستخدام معلومات السياق الكاملة في حساب التعيين الديناميكي.

يتم تطبيق التعيينات المقيدة الأخيرة:

- التنشيط السيني لـ H_pre وH_post (وبالتالي ضمان عدم السلبية)

- إسقاط Sinkhorn-Knopp لـ H_res (وبالتالي فرض العشوائية المزدوجة)

- تبدأ قيم التهيئة الصغيرة (α = 0.01) بعوامل التحفظ

يوقف هذا التكوين إلغاء الإشارة الناتج عن التفاعلات بين المعاملات الإيجابية والسلبية وفي نفس الوقت يحتفظ بخاصية تعيين الهوية المهمة جدًا.

سلوك التوسع: هل يصمد؟

واحدة من أكثر الأشياء المدهشة هي مدى فوائد MHC. أجرى DeepSeek تجاربه في ثلاثة أبعاد مختلفة:

- قياس الحساب: لقد تدربوا على المعلمات 3B و9B و27B مع البيانات التناسبية. ظلت ميزة الأداء كما هي، بل وزادت قليلاً عند الميزانيات الأعلى للحوسبة. وهذا أمر لا يصدق لأنه عادةً ما تكون العديد من الحيل المعمارية التي تعمل على نطاق صغير لا تعمل عند التوسع.

- تحجيم الرمز المميز: لقد قاموا بمراقبة الأداء طوال فترة التدريب على نموذج 3B الخاص بهم والذي تم تدريبه على 1 تريليون رمز. كان تحسن الخسارة مستقرًا منذ التدريب المبكر جدًا وحتى مرحلة التقارب، مما يشير إلى أن فوائد MHC لا تقتصر على فترة التدريب المبكر.

- تحليل الانتشار: هل تتذكر عوامل تضخيم الإشارة 3000x في الفانيليا HC؟ باستخدام mHC، تم تقليل الحد الأقصى لحجم الكسب إلى حوالي 1.6 وهو أكثر استقرارًا بثلاثة أوامر من حيث الحجم. حتى بعد تأليف أكثر من 60 طبقة، ظلت مكاسب الإشارة الأمامية والخلفية تحت السيطرة بشكل جيد.

معايير الأداء

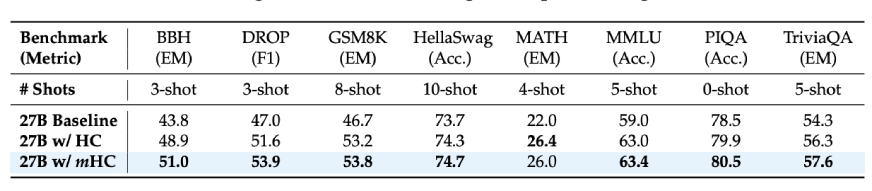

قام DeepSeek بتقييم MHC على نماذج مختلفة بأحجام معلمات تتراوح من 3 مليار إلى 27 مليار وكانت مكاسب الاستقرار واضحة بشكل خاص:

- كان فقدان التدريب سلسًا خلال العملية برمتها دون أي طفرات مفاجئة

- تم الاحتفاظ بمعايير التدرج في نفس النطاق، على عكس HC، الذي أظهر السلوك البري

- الشيء الأكثر أهمية هو أن الأداء لم يتحسن فحسب، بل ظهر أيضًا عبر العديد من المعايير

إذا أخذنا في الاعتبار نتائج المهام النهائية لنموذج 27B:

- مهام التفكير المنطقي لـ BBH: 51.0% (مقابل 43.8% خط الأساس)

- انخفاض فهم القراءة: 53.9% (مقابل 47.0% خط الأساس)

- المسائل الرياضية GSM8K: 53.8% (مقابل 46.7% خط الأساس)

- معرفة MMLU: 63.4% (مقابل 59.0% خط الأساس)

لا تمثل هذه تحسينات طفيفة ولكن في الواقع، نحن نتحدث عن زيادات بمقدار 7 إلى 10 نقاط في معايير الاستدلال الصعبة. بالإضافة إلى ذلك، لم تظهر هذه التحسينات على النماذج الأكبر حجمًا فحسب، بل أيضًا خلال فترات التدريب الأطول، وهو ما كان عليه الحال مع توسيع نطاق نماذج التعلم العميق.

اقرأ أيضًا: DeepSeek-V3.2-Exp: أرخص بنسبة 50%، وأسرع 3 مرات، وأقصى قيمة

خاتمة

إذا كنت تعمل على نماذج لغوية كبيرة أو تدربها، فإن mHC يعد أحد الجوانب التي يجب عليك أخذها في الاعتبار بالتأكيد. إنها واحدة من تلك الأبحاث النادرة، والتي تحدد مشكلة حقيقية، وتقدم حلاً صحيحًا رياضيًا، بل وتثبت أنها تعمل على نطاق واسع.

أهم الاكتشافات هي:

- تؤدي زيادة عرض الدفق المتبقي إلى أداء أفضل؛ ومع ذلك، فإن الأساليب الساذجة تسبب عدم الاستقرار

- إن قصر التفاعلات على المصفوفات العشوائية المضاعفة يحتفظ بخصائص تعيين الهوية

- إذا تم القيام به بشكل صحيح، يمكن أن يكون الحمل بالكاد ملحوظًا

- يمكن إعادة تطبيق المزايا على النماذج التي يصل حجمها إلى عشرات المليارات من المعلمات

علاوة على ذلك، يعد MHC بمثابة تذكير بأن التصميم المعماري لا يزال عاملاً حاسماً. لا يمكن لمسألة كيفية استخدام المزيد من الحوسبة والبيانات أن تستمر إلى الأبد. ستكون هناك أوقات عندما يكون من الضروري التراجع خطوة إلى الوراء، وفهم سبب الفشل على نطاق واسع، وإصلاحه بشكل صحيح.

وبصراحة، مثل هذا البحث هو أكثر ما أحبه. لا ينبغي إجراء تغييرات صغيرة، بل تغييرات عميقة من شأنها أن تجعل المجال بأكمله أكثر قوة.

قم بتسجيل الدخول لمواصلة القراءة والاستمتاع بالمحتوى الذي ينظمه الخبراء.

Source link