إنشاء نسخ إعلانية ومحتوى مدونة، وتمكين جمع البيانات، وتحسين الحملات، ومعالجة بيانات العملاء لبناء شخصيات مفصلة، وحتى أتمتة سير العمل التسويقي بالكامل بدءًا من رعاية العملاء المحتملين وحتى تتبع التحويل.

ينمو الذكاء الاصطناعي بسرعة كبيرة بحيث يمكنه تحمل غالبية مهامك التسويقية.

ومع ذلك، فإن الاستخدام غير المتوافق للذكاء الاصطناعي لأغراض التسويق، مثل لصق بيانات العملاء الحساسة في LLMs العامة دون موافقة أو عدم إبلاغ جمهورك بكيفية معالجة بياناتهم، يمكن أن يؤدي إلى غرامات ودعاوى قضائية وإلحاق الضرر بالسمعة.

في هذه المقالة، سنشارك بعض اللوائح الأساسية التي يستخدمها الذكاء الاصطناعي في التسويق، والأطر الأخلاقية التي يجب مراعاتها، ونصائح لاستخدام الذكاء الاصطناعي بشكل مسؤول مع حماية علامتك التجارية من الآثار القانونية.

اللوائح والقوانين الأساسية لاستخدام الذكاء الاصطناعي في التسويق

يشبه الذكاء الاصطناعي المتدرب في مجال التسويق ويمكن أن يرتكب أخطاء أحيانًا أو يتم استخدامه لارتكاب أخطاء عند التعامل مع بيانات المستهلك، مما يؤدي إلى نتائج تسويقية كارثية.

ولهذا السبب توجد لوائح عالمية وإقليمية، مثل القانون العام لحماية البيانات (GDPR)، وCAN-SPAM، وCCPA، وقانون الاتحاد الأوروبي للذكاء الاصطناعي، للحماية من هذه الأخطاء. دعونا نفهم هذه واحدة تلو الأخرى.

1. اللائحة العامة لحماية البيانات

اللائحة العامة لحماية البيانات (GDPR) هي قانون صممه الاتحاد الأوروبي لحماية الأفراد وبياناتهم داخل الاتحاد الأوروبي أو المنطقة الاقتصادية الأوروبية. وينطبق هذا على الشركات التي تتعامل داخل الحدود الأوروبية وتتفاعل مع بيانات المستهلك، سواء كانت الشركة موجودة فعليًا هناك أم لا.

إذا كنت ستستخدم الذكاء الاصطناعي للتفاعل مع بيانات عملائك، فأنت مكلف بتوضيح السبب والكيفية والأدوات التي تريد استخدامها. يجب عليك أيضًا منح المستخدمين القدرة على مسح بياناتهم من سجلاتك في أي وقت يختارونه. يمكن أن يكلف الاختراق ما يصل إلى 20 مليون يورو أو ما يصل إلى 4% من إجمالي مبيعاتك العالمية.

مثال آخر في الولايات المتحدة هو قانون خصوصية المستهلك في كاليفورنيا (CCPA).

2. CAN-SPAM

ينظم قانون مكافحة الاعتداء على المواد الإباحية والتسويق غير المرغوب فيها كيفية إرسال الشركات لرسائل البريد الإلكتروني التجارية. يتضمن ذلك استخدام سطور الموضوع والعناوين والنصوص الصادقة، مما يسمح للمستخدمين بإلغاء الاشتراك بسهولة وحسب الرغبة، وعدم إرسال رسائل البريد الإلكتروني إلا بموافقة.

ومع ذلك، فإن 34% من المسوقين، وفقًا لتقرير حالة اتجاهات البريد الإلكتروني الصادر عن شركة Litmus، يستخدمون أدوات الذكاء الاصطناعي الإنتاجية مثل ChatGPT لإنشاء نسخة بريد إلكتروني. وهذا يزيد من خطر وصول العناوين الخادعة والمشابهة لمحتوى Clickbait أو المحتوى غير المتوافق إلى رسائل البريد الإلكتروني الخاصة بك. يمكن أن يؤدي خرق قانون CAN-SPAM إلى فرض غرامات تصل إلى 53,088 دولارًا أمريكيًا لكل انتهاك للبريد الإلكتروني.

3. لدي قانون

أنشأ الاتحاد الأوروبي قانون الذكاء الاصطناعي لتوجيه الاستخدام الضار للذكاء الاصطناعي والوقاية منه. والأهم من ذلك بالنسبة للمسوقين الذين يستخدمون الذكاء الاصطناعي، أنه يجب إعلام عملائك عندما يتفاعلون مع أدوات الذكاء الاصطناعي أو الوسائط الاصطناعية على قنواتك.

تتضمن الوسائط الاصطناعية الصور التي تم إنشاؤها، والأصوات المستنسخة أو المركبة، والتزييف العميق، وحتى المؤثرين الافتراضيين الذين لا وجود لهم في الحياة الحقيقية. لذا، إذا كنت تستخدم أيًا من هذه العناصر حصريًا في المحتوى التسويقي الخاص بك، فيجب عليك تحديد عملائك وإبلاغهم بذلك. يمكن أن يكون الانتهاك مكلفًا كما هو الحال في حالة القانون العام لحماية البيانات (GDPR) وCAN-SPAM.

الاعتبارات الأخلاقية عند استخدام الذكاء الاصطناعي في التسويق

تركز لوائح الذكاء الاصطناعي على تنفيذ القوانين القانونية التي تحمي عملك من الآثار القانونية، بينما تسلط أخلاقيات الذكاء الاصطناعي الضوء على الالتزامات الأخلاقية التي يجب عليك اتباعها لكسب ثقة المستهلك. وتشمل هذه الالتزامات تعزيز الشمولية، والقضاء على التحيز، وضمان الشفافية عند استخدام الذكاء الاصطناعي لأغراض التسويق.

1. الشمولية

ونظرًا لأن الإنترنت يحتوي على أنماط متحيزة وتمييزية عبر الجنس والعرق واللون والقدرة، فإن نماذج الذكاء الاصطناعي المدربة على هذه البيانات يمكن أن تعكس تلك الأنماط. يمكن أن يؤدي هذا إلى نتائج متحيزة في الإعلانات ومنشورات وسائل التواصل الاجتماعي ومحتوى موقع الويب.

يمكن أن يؤدي هذا إلى رد فعل عام عنيف، وكسر ثقة المستهلك، والإضرار بالعلاقات العامة. في بعض الأحيان، حتى الغرامات. لهذا السبب يجب عليك تدريب أداة الذكاء الاصطناعي الخاصة بك لحظر المشاعر أو المحتوى المناهض للشمولية من مخرجاتها.

إذا كان الاستخدام ينتهك الشمولية باستمرار، فقد تحتاج إلى إعادة تدريب النموذج، أو ضبط مطالباته، أو التبديل إلى أداة ذات ضمانات أقوى وضوابط أفضل للإشراف.

2. القضاء على التحيز

يمكن أن ينجم تحيز الذكاء الاصطناعي عن تحيز البيانات، أو تحيز الخوارزمية، أو التحيز البشري. يحدث تحيز البيانات عندما يتم تدريب نظام الذكاء الاصطناعي الخاص بك على بيانات غير كاملة أو غير متوازنة منذ البداية. لذا فإن جميع مخرجاتها متحيزة أيضًا.

ومن ناحية أخرى، تصبح الخوارزميات متحيزة عندما تقوم بتدريب الذكاء الاصطناعي على تفضيل نتائج محددة، حتى عندما لا يدعمها المنطق. على سبيل المثال، سيستمر ChatGPT في إنتاج محتوى الحملة الذي يستهدف الرجال فقط إذا قمت بتدريبه على بيانات برنامج المقارنات الدولية (ICP) التي تتضمن في الغالب العملاء الذكور.

أما بالنسبة للتحيز البشري، فمن الأمثلة على ذلك عندما بدأ برنامج Grok، برنامج الدردشة الآلي التابع لشركة xAI، في دمج آراء إيلون موسك قبل الرد على المستخدمين.

تحتاج إلى القضاء على هذه التحيزات من خلال تدريب الذكاء الاصطناعي الخاص بك على بيانات العملاء التي تمت مراجعتها ووضع إرشادات واضحة للحياد في تصنيف البيانات والتصميم الفوري.

3. الشفافية

كن شفافًا بشأن استخدامك للذكاء الاصطناعي. أخبر المستخدمين عن سبب استخدامك للذكاء الاصطناعي، وما هي البيانات التي يعالجها، ومدة الاحتفاظ بها، ومتى يتم استخدامها. قم أيضًا بالكشف عن متى يتم إنشاء المحتوى بواسطة الذكاء الاصطناعي، خاصة إذا كان الذكاء الاصطناعي يلعب دورًا رئيسيًا.

وينطبق هذا أيضًا على استهداف الإعلانات المدعومة بالذكاء الاصطناعي. أضف سببًا لسبب رؤيتهم لإعلان أو توصية معينة – ربما لأنهم زاروا موقع الويب الخاص بك، أو استخدموا أداة، أو أعجبوا بعناصر مماثلة، والتقطت خوارزمية الذكاء الاصطناعي الخاصة بك ذلك.

كلما كنت أكثر شفافية بشأن مشاركة الذكاء الاصطناعي، زاد شعور المستهلكين بالثقة بشأن ثقتك في بياناتهم.

4 نصائح عملية لاستخدام الذكاء الاصطناعي بمسؤولية وامتثال

الذكاء الاصطناعي موجود ليبقى، ولكن عملك قد لا يكون موجودًا إذا فشلت في استخدامه بشكل مسؤول. فيما يلي أربع نصائح لتجنب ذلك والبقاء متوافقًا.

1. الحصول على موافقة صريحة

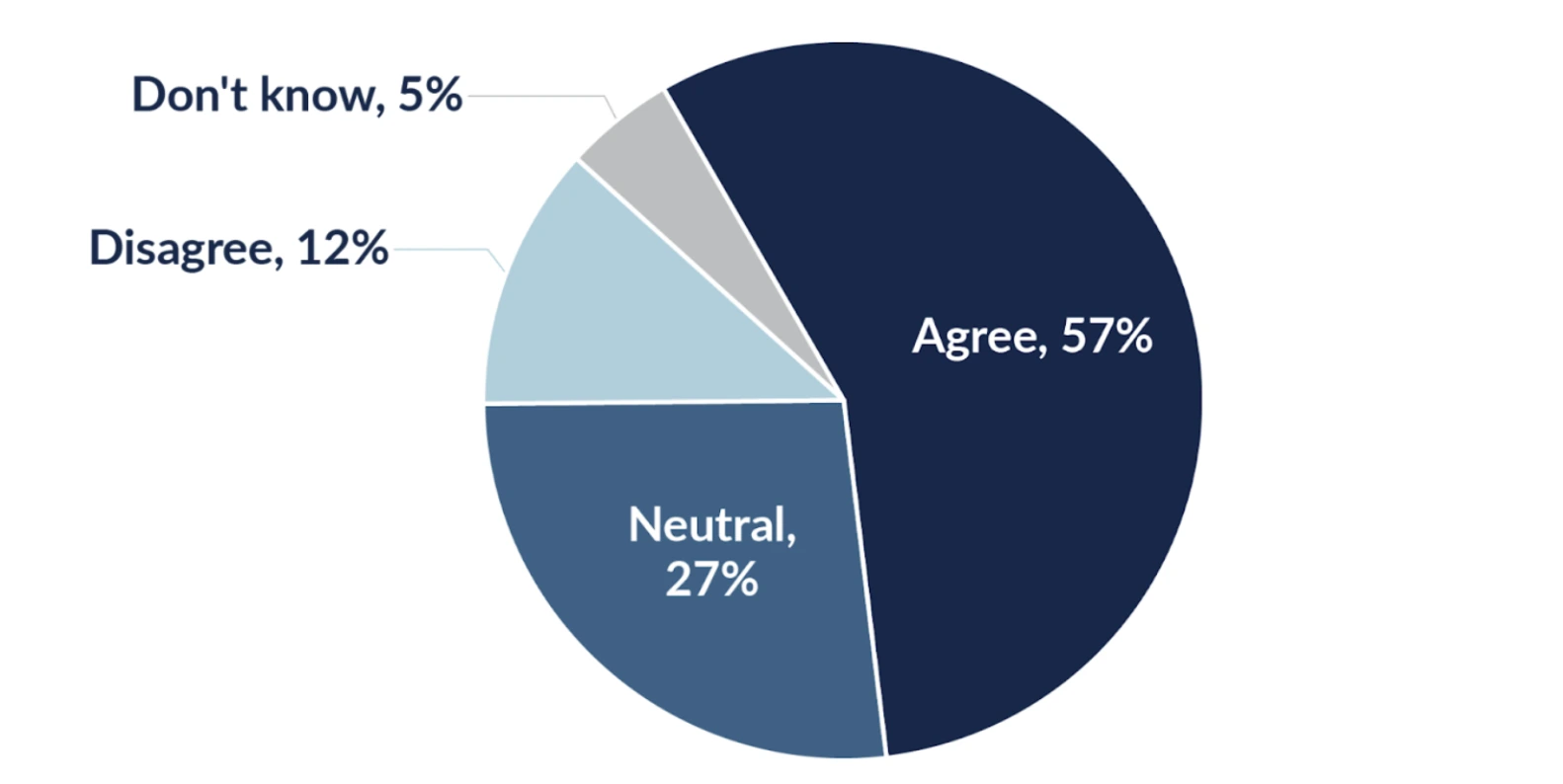

وفق IAPP 2023 الخصوصية أوفي تقرير ثقة المستهلك، يشعر 68% من المستهلكين بالقلق بشأن خصوصية بياناتهم عبر الإنترنت، ويوافق 57% منهم على أن الذكاء الاصطناعي يشكل تهديدًا كبيرًا لهذه الخصوصية.

لذا، فإن استخدام الذكاء الاصطناعي لمعالجة البيانات لأغراض تسويقية دون موافقة مناسبة أو استخدام دقيق يمكن أن يؤدي إلى تآكل الثقة الهشة بالفعل. علاوة على ذلك، فإن الاستخدام غير الموافق عليه لبيانات المستهلك، سواء مع الذكاء الاصطناعي أو بدونه، ينتهك القانون العام لحماية البيانات (GDPR) وقانون خصوصية المستهلك في كاليفورنيا (CCPA) والعديد من قوانين حماية البيانات الأخرى.

لمنع ذلك:

- قم بإنشاء صفحة سياسة خصوصية قياسية وإشعار يشرح بالتفصيل استخدام الذكاء الاصطناعي

- طلب الموافقة المناسبة قبل جمع البيانات ومعالجتها

- قم بإعداد عملية تأكيد مزدوجة قبل استخدام البيانات وإشراك الذكاء الاصطناعي

- قم بمراجعة المستخدمين بانتظام وإعادة مطالبتهم بالموافقة في حالة رغبتهم في إلغاء الاشتراك

يجب عليك أيضًا أن تسهل على الأشخاص حذف بياناتهم أو طلب حذفها.

2. استخدم منصات الذكاء الاصطناعي الآمنة

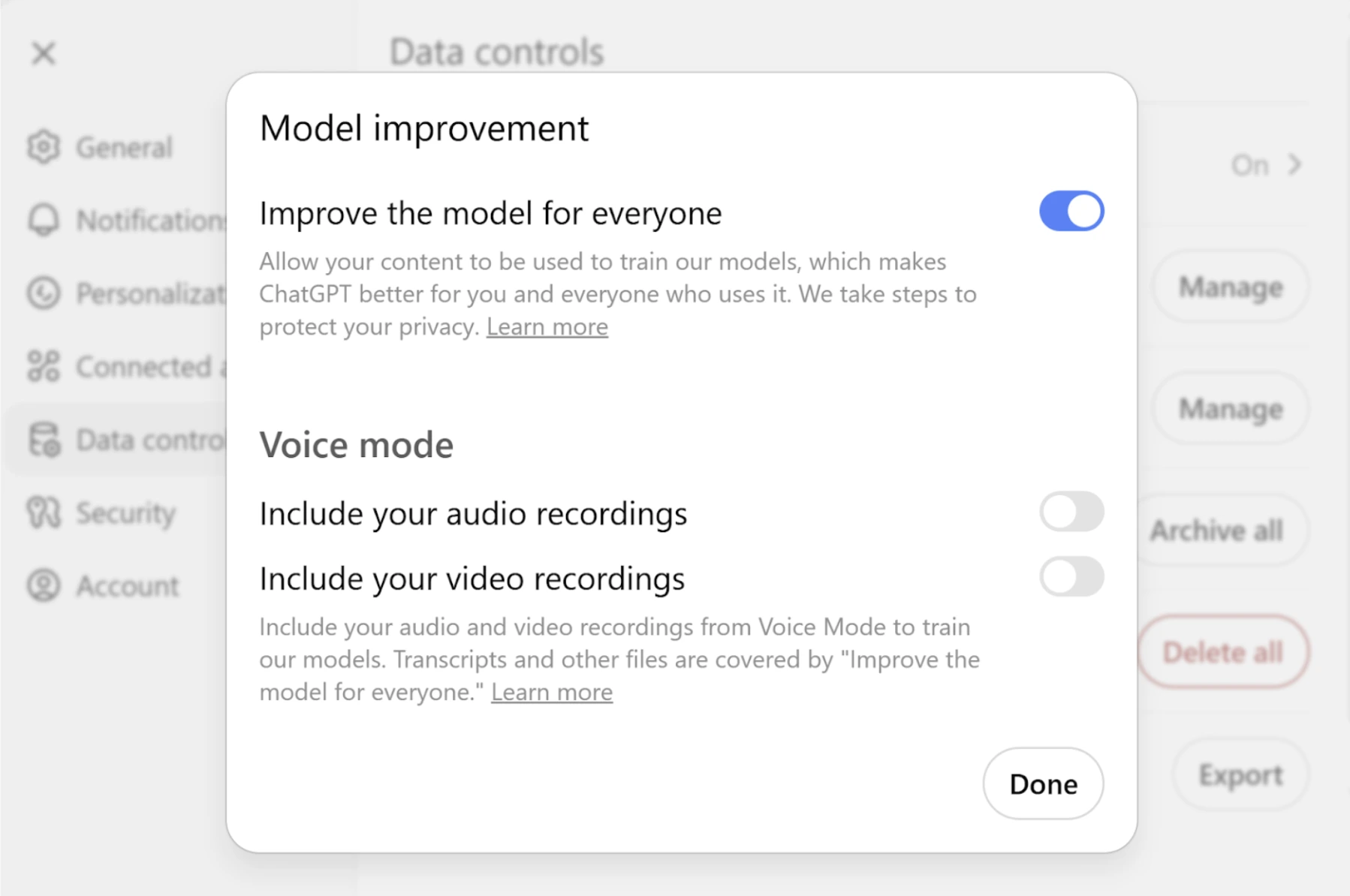

تمكّنك دورات LLM العامة، مثل الإصدار المجاني من ChatGPT وPerplexity وGemini، من معالجة كمية كبيرة من بيانات التسويق وإنشاء محتوى أمامي لجذب العملاء المحتملين. المشكلة الوحيدة هي أن هذا الاشتراك المجاني يوقعك تلقائيًا على اتفاقية مشاركة البيانات ما لم تقم بإيقاف تشغيلها يدويًا.

يتم استخدام بياناتك لتدريب أدوات الذكاء الاصطناعي هذه، وفي بعض الحالات، لضبط مخرجاتها للمستخدمين الآخرين. على الرغم من أن هذا ليس مطلقًا، إلا أنه قد ينتهي بك الأمر إلى العثور على أجزاء من معلومات عميلك أو أنماطه أو سلوكياته تنعكس في الردود المقدمة للآخرين. وهذا ينتهك قوانين خصوصية المستهلك.

لتجنب مثل هذه النتائج:

- استخدم فقط النسخة المدفوعة من LLMs ذات المصداقية

- قم دائمًا بإلغاء الاشتراك في اتفاقيات مشاركة البيانات قبل لصق بياناتك

- استخدم أدوات تحليل البيانات المدعومة بالذكاء الاصطناعي مثل Snowflake لمعالجة بياناتك التسويقية في مساحة خاصة

والأهم من ذلك، الابتعاد عن برامج الدردشة الآلية وأدوات الذكاء الاصطناعي المجانية عبر الإنترنت، حتى لو كانت توفر عليك الآلاف من التكلفة. قبل أن تسمح لأداة تسويق تعمل بالذكاء الاصطناعي بالوصول إلى بيانات العملاء الأكثر حساسية، يتعين عليك بذل العناية الواجبة والتدقيق في الشركة التي تقف وراءها. قم بمراجعة مستندات الأمان وسياسات الخصوصية وسمعتهم عبر الإنترنت، والتي قاموا ببنائها على مر السنين.

يمكنك أيضًا استخدام أداة مجانية للتحقق من موقع Google لاسم علامتها التجارية ومعرفة كيفية أداء البائع لخدماته الأساسية. إذا كانت مدفونة في الصفحة العاشرة من SERPs بدلاً من الصفحة الأولى، فتابع بحذر. غالبًا ما تكون الشركة التي تتمتع بتصنيفات عضوية قوية، ولكن ليس دائمًا، شريكًا أكثر استقرارًا وأقل مخاطرة وقد خدم عملائها بشكل جيد. لديهم علامة تجارية أصلية لحمايتها ومن غير المرجح أن يأخذوا حرياتهم فيما يتعلق ببياناتك والتزاماتهم القانونية.

3. قم بمراجعة مخرجات الذكاء الاصطناعي بانتظام

الذكاء الاصطناعي متعدد الاستخدامات ويتفوق في العديد من المجالات، ويحقق الكمال. ومع ذلك، لا يزال الأمر يتطلب مدخلات ومراقبة بشرية للبقاء آمنًا. على سبيل المثال، قد تؤدي أداة الذكاء الاصطناعي الخاصة بك إلى الهلوسة، أي توليد معلومات تبدو صحيحة ولكنها في الواقع خاطئة أو مضللة أو ملفقة بالكامل، على الرغم من تزويدها بأفضل مطالبة ممكنة.

إذا لم تقم بمراجعة مخرجاتك قبل نشرها على قناتك، فإنك تخاطر بانتشار المنشورات الخاطئة أو إثارة غضب جمهورك. علاوة على ذلك، يمكن للمعلومات التسويقية الكاذبة أن تؤدي إلى تآكل ثقة المستهلكين في عملك.

منع ذلك عن طريق:

- إنشاء فريق مراجعة محتوى احتياطي لمراقبة كل مخرجات الذكاء الاصطناعي قبل نشرها

- قم بتزويد فريقك بإجراءات التشغيل المعيارية (SOP) لاستخدام الذكاء الاصطناعي والتي تحدد الكلمات التي يجب تجنبها وأي نغمة أو صوت العلامة التجارية يجب أن يتبعه المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي.

يجب على فريقك أيضًا إجراء مراجعة بأثر رجعي للمحتوى أو الحملات السابقة التي تم إنشاؤها جزئيًا أو كليًا باستخدام الذكاء الاصطناعي، لضمان اتساق العلامة التجارية.

استشر فريقك القانوني قبل استخدام أدوات تسويق الذكاء الاصطناعي الجديدة. تعامل مع الامتثال باعتباره الفلتر الأول عند فحص البائعين، لأن المخاطرة لا تستحق تحسينًا بسيطًا في الأداء.

4. كن على اطلاع دائم بالقوانين

تعامل مع الامتثال للذكاء الاصطناعي كمهمة متكررة. تتطور القوانين المتعلقة بخصوصية البيانات واستخدام الذكاء الاصطناعي بشكل متكرر، لذا قم بمراجعة اللوائح المعمول بها في مناطق التشغيل الخاصة بك كل ثلاثة أشهر.

يجب أن تكون اللوائح التنظيمية الأوسع، مثل اللائحة العامة لحماية البيانات وقانون الاتحاد الأوروبي للذكاء الاصطناعي، في مقدمة المراجعة ربع السنوية إذا كنت تعمل في أوروبا. في بلدان مثل الولايات المتحدة الأمريكية، توفر الولايات المختلفة قوانين خصوصية البيانات الخاصة بها. ومن الأمثلة على ذلك CCPA لولاية كاليفورنيا.

بالإضافة إلى ذلك، تأكد من أنك على دراية بالقوانين واللوائح التي سنتها ولايتك، بما يتجاوز القواعد واللوائح الإقليمية.

خاتمة

لقد تسلل الذكاء الاصطناعي ببطء إلى جوهر التسويق، ولن يتغير هذا في أي وقت قريب. ومع ذلك، كلما زاد اعتمادك عليها بشكل كبير لإدارة عملياتك التسويقية، كلما زاد اتصالها ببيانات المستهلك، وأصبح من الأسهل ارتكاب الأخطاء أو اختراق الحواجز القانونية المحيطة بهذه البيانات.

حافظ على سلامتك من خلال تحديث مؤسستك من المبيعات إلى التسويق بجميع اللوائح وقوانين خصوصية البيانات ذات الصلة. تأكد من حصولك على موافقة صريحة قبل جمع أو معالجة بيانات أي مستهلك باستخدام الذكاء الاصطناعي. أيضًا، من أجل الامتثال القانوني الكامل، قم بمراجعة كل مخرجات بانتظام، سواء تم إنشاؤها جزئيًا أو كليًا بواسطة الذكاء الاصطناعي.

وأخيرًا، ابق على اطلاع دائم بالقوانين وكن على دراية باللوائح الجديدة مع استمرار تزايد اعتماد الذكاء الاصطناعي في التسويق.

الأسئلة المتداولة

تتضمن أكبر المخاطر القانونية إدخال بيانات المستهلك في أدوات الذكاء الاصطناعي غير الآمنة، مما قد يؤدي إلى تسرب أو نشر محتوى مضلل وغير مدقق تم إنشاؤه بواسطة الذكاء الاصطناعي على قناتك التسويقية. يمكن أن يؤدي أي منهما إلى آثار قانونية، بما في ذلك الغرامات المالية والدعاوى القضائية وتآكل ثقة العملاء.

لا، ليس كذلك. تعمل أدوات الذكاء الاصطناعي العامة، وخاصة النماذج المجانية، على تمكينك تلقائيًا من الانضمام إلى اتفاقية مشاركة البيانات. لكي تكون في الجانب الآمن، استخدم منصات الذكاء الاصطناعي لتحليل البيانات الخاصة مثل Snowflake. يمكنك أيضًا استخدام الاشتراكات المدفوعة لمنصات مثل ChatGPT وGemini وPerplexity.

ابدأ بتدريب نظام الذكاء الاصطناعي الخاص بك على البيانات غير المتحيزة، وقم بوضع حواجز حماية لمنعه من اتخاذ قرارات لا تتوافق مع أهداف علامتك التجارية، وقم بإنشاء فريق مراجعة بشري لإجراء التدقيق المناسب.

لا، لا ينبغي للذكاء الاصطناعي التعامل مع جميع عملياتك التسويقية، ويجب أن يتم اتخاذ القرارات التسويقية من خلال مؤسستك فقط. ومع ذلك، يمكنك استخدام أدوات الذكاء الاصطناعي الموثوقة للمساعدة في تحليل البيانات اللازمة لاتخاذ القرارات المحورية.

قم بتسجيل الدخول لمواصلة القراءة والاستمتاع بالمحتوى الذي ينظمه الخبراء.