تبدو أنظمة الذكاء الاصطناعي أكثر ذكاءً من أي وقت مضى. يجيبون بسرعة وثقة وصقل. ولكن تحت هذا السطح، هناك شيء خفي يحدث على نحو خاطئ. أصبحت المخرجات أكثر أمانًا. الأفكار أصبحت أضيق. المفاجأة تختفي – أقل رعبًا.

وهذا مهم لأن الذكاء الاصطناعي يشارك بشكل متزايد في كيفية البحث والقرار والإبداع والتقييم. عندما تفقد هذه الأنظمة نطاقها، فإنها لا تصبح أسوأ في حالات الحافة فحسب. توقفوا عن رؤية الأشخاص الذين يعيشون على الحواف. وتسمى هذه الظاهرة انهيار النموذج.

تتناول هذه المقالة ماهية انهيار النموذج، وأسبابه، وكيف يمكن الوقاية منه.

ما هو انهيار النموذج؟

بناءً على ورقة بحث Nature: انهيار النموذج هو ظاهرة تتدهور فيها نماذج التعلم الآلي تدريجيًا بسبب الأخطاء الناتجة عن التدريب غير المنظم على مخرجات نموذج آخر، مثل الإصدارات السابقة من نفسه.

على غرار التعلم اللاشعوري حيث يتم تمرير انحياز النماذج إذا تم استخدام نفس النماذج العائلية لتدريب النماذج اللاحقة، في انهيار النموذج، تصبح معرفة النموذج ضيقة ومحدودة بسبب القيود المفروضة على بيانات التدريب الاصطناعية.

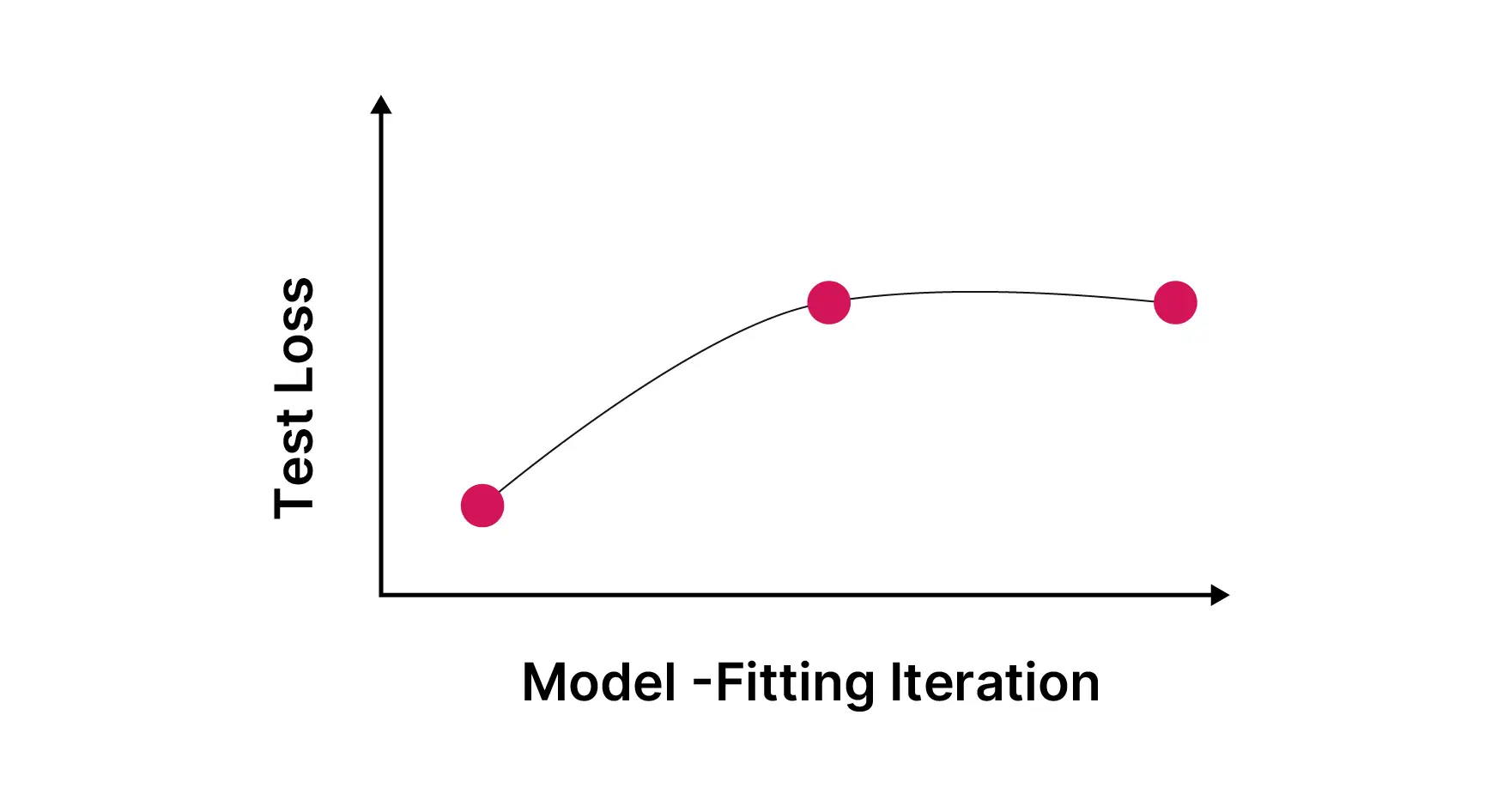

لا شيء يتعطل. لا تزال المعايير تبدو جيدة. متوسط الأداء يبقى قويا. لكن النموذج يفقد نطاقه ببطء. الحالات النادرة تتلاشى وتختفي وجهات النظر غير المألوفة. تتقارب المخرجات نحو ما هو أكثر شيوعًا وتكرارًا وأمانًا إحصائيًا.

وبمرور الوقت، لا يفشل النموذج. إنه يضيق. إنه لا يزال يعمل ولكن “المتوسط” يصبح هو الشيء الوحيد الذي يفهمه. الحالات الطرفية أو القيم المتطرفة التي كان من السهل الاستجابة لها سابقًا، أصبحت خارج الحدود الآن.

ما الذي يسبب انهيار النموذج؟

الآلية بسيطة، وهذا هو سبب خطورتها. من السهل التغاضي عن هذه المشكلة، إذا لم يتمكن المرء من تحديد مصدر البيانات.

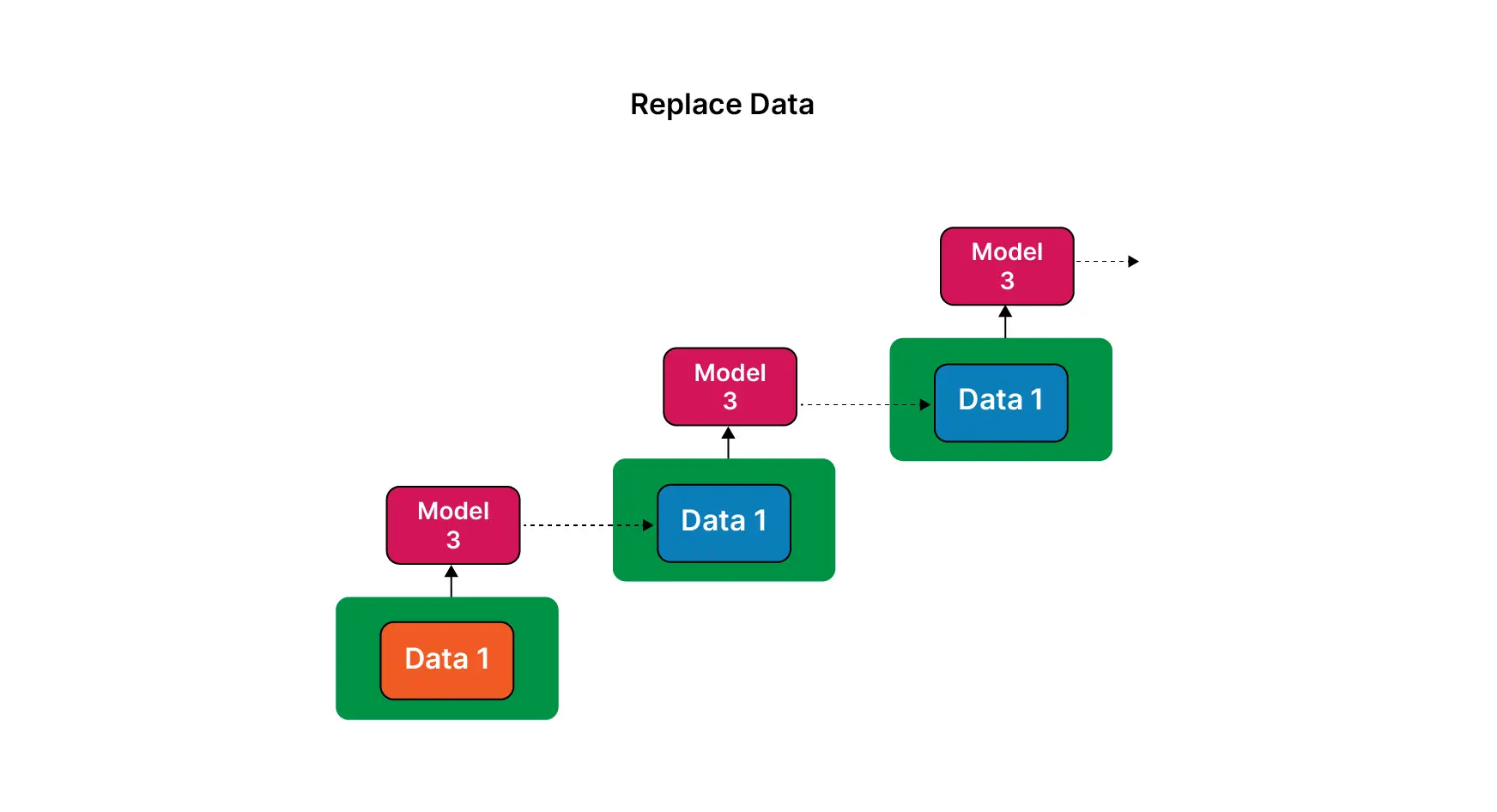

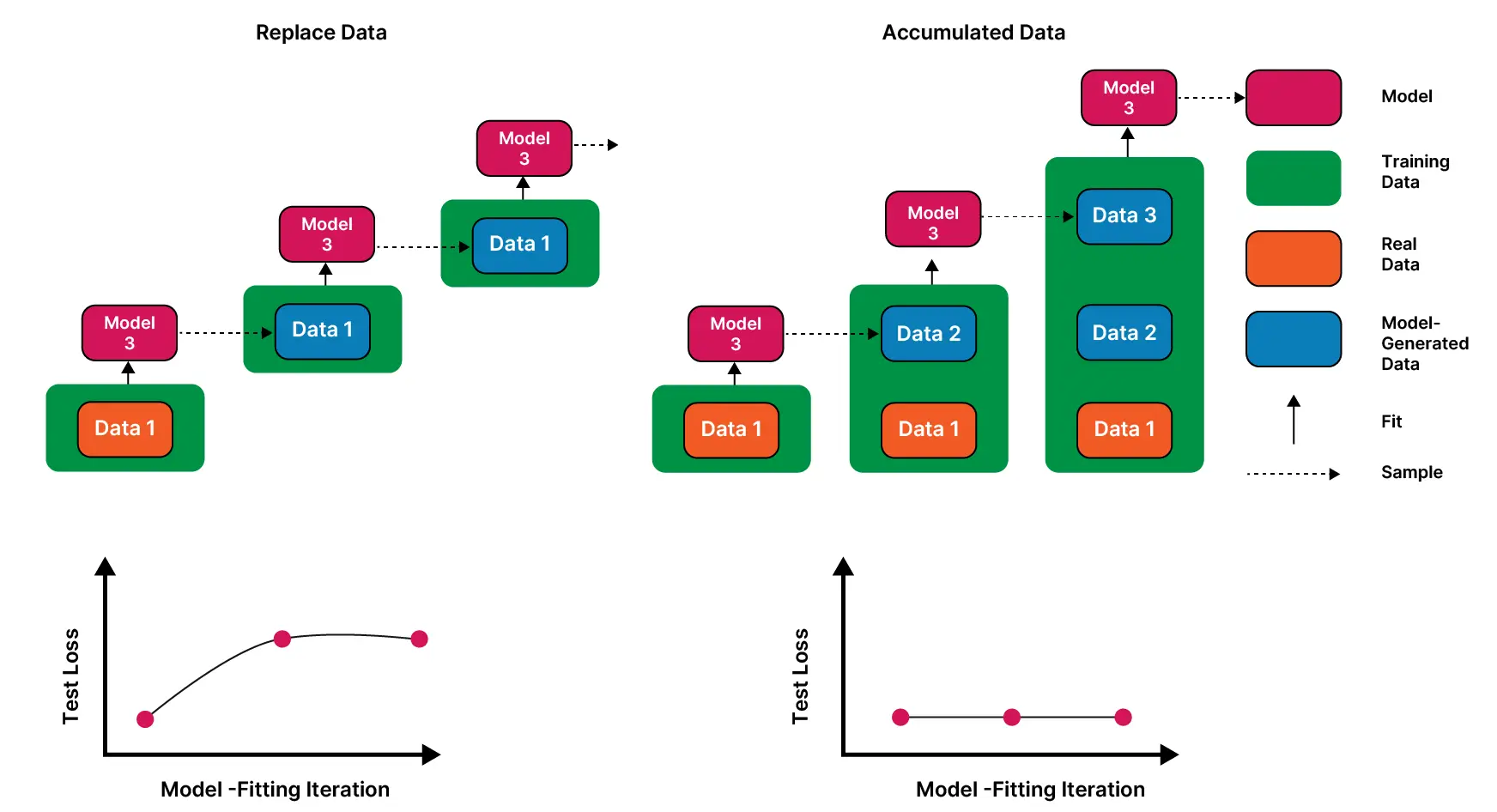

تعلمت النماذج المبكرة في الغالب من البيانات التي أنشأها الإنسان. ولكن مع انتشار المحتوى الناتج عن الذكاء الاصطناعي عبر الويب ومجموعات البيانات وخطوط الأنابيب الداخلية، تتدرب النماذج الأحدث بشكل متزايد على المخرجات الاصطناعية. يرث كل جيل النقاط العمياء التي كانت موجودة في الجيل السابق ويعمل على تضخيمها.

وتبرز هذه المشكلة عند استخدام البيانات بشكل عشوائي لأغراض التدريب بغض النظر عن مصدرها. يؤدي هذا إلى نقل الأنماط من نموذج إلى آخر. لذلك، بدلاً من الحصول على منظور أوسع، يصبح النموذج ملائمًا بشكل وثيق لسلوك النموذج السابق.

ونتيجة لهذا، فإن البيانات النادرة هي أول من يذهب. لا يلاحظه النموذج أو يأخذه بعين الاعتبار أثناء تدريبه. الثقة لا تزال عالية. هذا ليس خطأ أو خطأ لمرة واحدة. إنها تراكمية وأجيال. بمجرد خروج المعلومات من حلقة التدريب، غالبًا ما تختفي إلى الأبد. وتتضاءل احتمالية فهم العلاقات الخارجية بشكل أكبر مع استمرار هذه الدورة.

يؤثر طي النموذج على أنواع النماذج المختلفة

فيما يلي بعض الطرق التي يؤثر من خلالها انهيار النموذج على نماذج الذكاء الاصطناعي ذات الأساليب المختلفة:

- تبدأ النماذج النصية في الظهور بطلاقة ولكنها جوفاء. الإجابات متماسكة ولكنها متكررة. يتم استبدال الأفكار الجديدة بالعبارات المعاد تدويرها والأفكار الآمنة المتفق عليها. السابق. استخدام em-dash ينفجر في استجابات نموذج الذكاء الاصطناعي.

- تتوقف أنظمة التوصية عن مفاجأتك. تبدو الخلاصات أضيق، ليس لأنك تغيرت، ولكن لأن النظام قام بتحسين الفضول. السابق. الأشخاص الذين تجاوزوا اهتماماتهم السابقة في وسائل الإعلام، يُعرض عليهم باستمرار توصيات مشابهة لما كانوا عليه سابقًا.

- تتلاقى نماذج الصور والفيديو في أنماط وتركيبات مألوفة. التباين موجود، ولكن ضمن صندوق جمالي متقلص. السابق. تعمل نماذج الذكاء الاصطناعي المختلفة على إنشاء صور بشرية باستخدام 6 أصابع بدلاً من 5.

هذه الأنظمة لا تعاني من خلل. إنهم يقومون بتحسين أنفسهم إلى التشابه.

كيف يمكن منع انهيار النموذج؟

لا توجد خدعة ذكية أو اختراق معماري لإصلاح هذا الأمر. المصدر هو المفتاح! لا يتعلق الأمر بما يتم رفضه، بل بالأحرى متى يُسمح له بالدخول.

- الحفاظ على البيانات التي ينشئها الإنسان وتحديد أولوياتها: أنشئ تقسيمات بتصنيف واضح بين البيانات التي ينشئها الذكاء الاصطناعي والبيانات التي ينشئها الإنسان.

- أصل: تتبع أصل بيانات التدريب بدلاً من التعامل معها على أنها قابلة للتبديل.

- الثقة فوق الراحة: تجنب استبدال تعقيد العالم الحقيقي بالراحة الاصطناعية. قد يكون من المناسب استخدام البيانات الناتجة عن الذكاء الاصطناعي بدلاً من البيانات الإنسانية، حيث يمكن تنظيمها بسهولة. لكن الجانب السلبي هو السلوك المتحيز للمركز.

- يتراوح: قيمة التباين بنشاط. وهذا يضمن أنه على الرغم من أن معظم المدخلات قد تكون في نفس المجموعة، إلا أن هناك مجالًا مفتوحًا للآخرين أيضًا. على الرغم من أنها تقلل من الكفاءة أو الأداء على المدى القصير، إلا أنها استراتيجية قابلة للتطبيق لمنع منع الإفراط في التجهيز.

- الشمولية: تعامل مع الحالات النادرة كأصول، وليس كضوضاء. هذه القيم المتطرفة هي بوابة للتفكير خارج الصندوق، ويجب التعامل معها بالمثل.

هذا لا يتعلق بالنماذج الأكثر ذكاءً. يتعلق الأمر بالحكم الأفضل على كيفية تدريبهم وتحديثهم.

خاتمة

إذا كان هناك شيء واحد يمكن قوله بالتأكيد، فهو أن الاستهلاك الذاتي لبيانات الذكاء الاصطناعي للنماذج يمكن أن يكون كارثيًا. يعد انهيار النموذج اقتراحًا آخر في الأطروحة المتزايدة باستمرار حول عدم استخدام بيانات الذكاء الاصطناعي لتدريب الذكاء الاصطناعي – بشكل متكرر. إذا تم تدريب النماذج بشكل مستمر على بيانات الذكاء الاصطناعي، فإنها تميل إلى التدهور. انهيار النموذج والوضع، كلاهما يشيران إلى نفس الاتجاه. وينبغي استخدام هذا كتحذير وقائي لأولئك الذين يميلون إلى عدم المبالاة تجاه مصدر بيانات التدريب الخاصة بهم.

الأسئلة المتداولة

ج: إنه التضييق التدريجي لقدرات نموذج الذكاء الاصطناعي عند تدريبه على بيانات غير منظمة تم إنشاؤها بواسطة الذكاء الاصطناعي، مما يتسبب في اختفاء الحالات النادرة والتنوع. تم لصقه

ج: تحافظ النماذج على ثقتها وأدائها في المتوسطات بينما تفشل بصمت في الحالات المتطرفة، مما يؤدي إلى نتائج متحيزة ومتكررة وأقل شمولاً. تم لصقه

أ. نعم. من خلال إعطاء الأولوية للبيانات البشرية، وتتبع مصدر البيانات، ومعاملة الحالات النادرة كأصول بدلاً من الضجيج. تم لصقه

قم بتسجيل الدخول لمواصلة القراءة والاستمتاع بالمحتوى الذي ينظمه الخبراء.