ثورة الذاكرة المشروطة للماجستير في القانون

إذا كنت على اطلاع دائم بالتطورات الأخيرة في الذكاء الاصطناعي ومجالات LLM، فمن المحتمل أنك أدركت أن جزءًا كبيرًا من التقدم لا يزال يتم من خلال بناء نماذج أكبر أو توجيه حسابي أفضل. حسنًا، ماذا لو كان هناك طريق بديل آخر؟ على طول جاء انجرام! طريقة ثورية لـ DeepSeek AI تعمل على تغيير وجهة نظرنا بشأن توسيع نطاق نماذج اللغة.

ما هي المشكلة التي يحلها إنجرام؟

خذ بعين الاعتبار السيناريو: تكتب “الإسكندر الأكبر” في نموذج اللغة. والآن، تنفق موارد حسابية قيمة لإعادة بناء هذه العبارة الشائعة من الصفر، في كل مرة. إنه مثل وجود عالم رياضيات لامع عليه أن يعيد عد جميع الأرقام العشرة، قبل حل أي معادلة معقدة.

لا تحتوي نماذج المحولات الحالية على طريقة مخصصة “للبحث” ببساطة عن الأنماط الشائعة. أنها تحاكي استرجاع الذاكرة من خلال الحساب، وهو غير فعال. يقدم إنجرام ما يسميه الباحثون الذاكرة المشروطة, تكملة للحساب الشرطي الذي نراه في نماذج خليط الخبراء (MoE).

النتائج تتحدث عن نفسها. في الاختبارات المعيارية، أظهر Engram-27B تحسينات ملحوظة مقارنة بنماذج وزارة التعليم المماثلة:

- كسب 5.0 نقطة في مهام التفكير المنطقي لـ BBH

- تحسين بمقدار 3.4 نقطة في اختبارات معرفة MMLU

- تعزيز بمقدار 3.0 نقاط عند إنشاء كود HumanEval

- دقة 97.0 مقابل 84.2 في اختبارات إبرة في كومة قش متعددة الاستعلامات

الميزات الرئيسية لإنجرام:

الملامح الرئيسية لإنجرام هي:

- تخصيص التباعد: لقد حددنا قانون القياس على شكل حرف U الذي يوجه التخصيص الأمثل للسعة، مما يعرض المفاضلة بين الحساب العصبي (MoE) مقابل الذاكرة الثابتة (Engram) كمعضلة.

- التحقق التجريبي: يوفر نموذج Engram-27B مكاسب ثابتة على الخطوط الأساسية لوزارة التربية والتعليم في مجالات المعرفة والتفكير والبرمجة والرياضيات في ظل ظروف صارمة من معايير ISO وISO-FLOPs.

- التحليل الميكانيكي: تشير نتائج تحليلنا إلى أن Engram يسمح للطبقات المبكرة بالتحرر من إعادة بناء النمط الثابت، مما قد يؤدي إلى الحفاظ على العمق الفعال للاستدلال المعقد.

- كفاءة النظام: تستخدم الوحدة معالجة حتمية تسمح بنقل الجداول المضمنة ذات الحجم الكبير إلى الذاكرة المضيفة مع زيادة طفيفة فقط في وقت الاستدلال.

كيف يعمل إنجرام فعليًا؟

تمت مقارنة Engram بجدول بحث عالي السرعة في حالة نماذج اللغة التي يمكنها الوصول بسهولة إلى الأنماط المتكررة.

العمارة الأساسية

يعتمد منهج إنجرام على فكرة بسيطة جدًا ولكنها أيضًا قوية جدًا: فهو يعتمد على تضمينات N-gram (تسلسلات من الرموز المميزة N المتتالية) التي يمكن البحث عنها في الوقت الثابت O(1). بدلاً من الاحتفاظ بكل مجموعة كلمات محتملة مخزنة، فإنها تستخدم وظائف التجزئة لتعيين الأنماط للتضمينات بطريقة فعالة.

هناك ثلاثة أجزاء رئيسية لهذه البنية:

- ضغط الرمز المميز: قبل البحث عن الأنماط، يقوم Engram بتوحيد الرموز المميزة، لذا يشير “Apple” و”apple” إلى نفس المفهوم. يؤدي هذا إلى تقليل حجم المفردات الفعالة بنسبة 23%، مما يؤدي إلى زيادة كفاءة النظام.

- التجزئة متعددة الرؤوس: لمنع الاصطدامات (أي تعيين أنماط مختلفة لنفس الموقع)، يستخدم Engram وظائف تجزئة متعددة. على سبيل المثال، فكر في الأمر على أنه يحتوي على العديد من دفاتر الهاتف المختلفة – إذا أعطاك أحدها رقمًا خاطئًا، فسوف يدعمك الآخرون.

- البوابات المدركة للسياق: هذا هو الجزء الذكي. ليست كل الذاكرة التي يتم استردادها ذات صلة بالموضوع، لذلك يستخدم إنجرام آليات تشبه الانتباه لتحديد مدى الثقة في كل عملية بحث وفقًا للسياق الحالي. إذا كان النمط في غير مكانه، فسوف تنخفض قيمة البوابة نحو الصفر، وسيتم تجاهل النمط بشكل فعال.

اكتشاف قانون القياس

من بين العديد من الاكتشافات المثيرة للاهتمام، يبرز قانون التحجيم على شكل حرف U. تمكن الباحثون من تحديد الأداء الأمثل عندما تم تخصيص حوالي 75-80% من السعة لوزارة التربية و20-25% فقط لذاكرة Engram.

يشير MoE الكامل (100%) إلى عدم وجود ذاكرة مخصصة للنموذج، وبالتالي، لا يوجد استخدام مناسب للحساب لإعادة بناء الأنماط الشائعة. عدم وجود وزارة التربية (0٪) يعني أن النموذج لا يستطيع القيام بالاستدلال المعقد بسبب قلة القدرة الحسابية لديه. النقطة المثالية هي حيث يكون كلاهما متوازنًا.

الشروع في العمل مع انجرام

- قم بتثبيت Python بالإصدار 3.8 والإصدارات الأحدث.

- ثَبَّتَ

numpyباستخدام الأمر التالي:

pip install numpy التدريب العملي: فهم تجزئة N-gram

دعونا نلاحظ كيف تعمل آلية التجزئة الأساسية لـ Engram مع مهمة عملية.

تنفيذ البحث الأساسي عن تجزئة N-gram

في هذه المهمة، سنرى كيف يستخدم Engram التجزئة الحتمية لتعيين تسلسلات الرموز المميزة للتضمينات، مما يتجنب تمامًا متطلبات تخزين كل N-gram محتمل بشكل منفصل.

1: تهيئة البيئة

import numpy as np

from typing import List

# Configuration

MAX_NGRAM = 3

VOCAB_SIZE = 1000

NUM_HEADS = 4

EMBEDDING_DIM = 128 2: قم بإنشاء محاكي ضغط رمزي بسيط

def compress_token(token_id: int) -> int:

# Simulate normalization by mapping similar tokens

# In real Engram, this uses NFKC normalization

return token_id % (VOCAB_SIZE // 2)

def compress_sequence(token_ids: List(int)) -> np.ndarray:

return np.array((compress_token(tid) for tid in token_ids))3: تنفيذ وظيفة التجزئة

def hash_ngram(tokens: List(int),

ngram_size: int,

head_idx: int,

table_size: int) -> int:

# Multiplicative-XOR hash as used in Engram

multipliers = (2 * i + 1 for i in range(ngram_size))

mix = 0

for i, token in enumerate(tokens(-ngram_size:)):

mix ^= token * multipliers(i)

# Add head-specific variation

mix ^= head_idx * 10007

return mix % table_size

# Test it

sample_tokens = (42, 108, 256, 512)

compressed = compress_sequence(sample_tokens)

hash_value = hash_ngram(

compressed.tolist(),

ngram_size=2,

head_idx=0,

table_size=5003

)

print(f"Hash value for 2-gram: {hash_value}")4: إنشاء بحث تضمين متعدد الرؤوس

def multi_head_lookup(token_sequence: List(int),

embedding_tables: List(np.ndarray)) -> np.ndarray:

compressed = compress_sequence(token_sequence)

embeddings = ()

for ngram_size in range(2, MAX_NGRAM + 1):

for head_idx in range(NUM_HEADS):

table = embedding_tables(ngram_size - 2)(head_idx)

table_size = table.shape(0)

hash_idx = hash_ngram(

compressed.tolist(),

ngram_size,

head_idx,

table_size

)

embeddings.append(table(hash_idx))

return np.concatenate(embeddings)

# Initialize random embedding tables

tables = (

(

np.random.randn(5003, EMBEDDING_DIM // NUM_HEADS)

for _ in range(NUM_HEADS)

)

for _ in range(MAX_NGRAM - 1)

)

result = multi_head_lookup((42, 108, 256), tables)

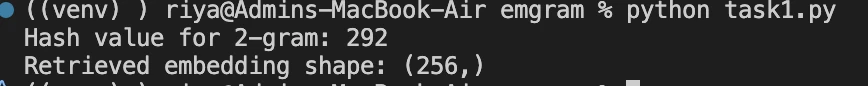

print(f"Retrieved embedding shape: {result.shape}")الإخراج:

فهم نتائجك:

قيمة التجزئة 292: يوجد نمط 2 جرام الخاص بك في هذا الفهرس في جدول التضمين. تتغير القيمة مع رموز الإدخال الخاصة بك، وبالتالي تظهر التعيين الحتمي.

الشكل (256،): تم استرداد إجمالي 8 عمليات تضمين (أحجام N-gram × 4 رؤوس لكل منهما)، حيث يبلغ أبعاد كل تضمين 32 (EMBEDDING_DIM=128 / NUM_HEADS=4). متسلسل: 8 × 32 = 256 بُعدًا.

ملحوظة: يمكنك أيضًا رؤية تنفيذ Engram عبر المنطق الأساسي لوحدة Engram.

مكاسب الأداء في العالم الحقيقي

تعد حقيقة أن Engram يمكنه المساعدة في المهام المعرفية ميزة رائعة، ولكنها في الواقع تجعل التفكير وتوليد الأكواد أفضل بشكل ملحوظ.

يحول Engram التعرف على الأنماط المحلية إلى عمليات البحث في الذاكرة، وبالتالي يتم تمكين آليات الانتباه للعمل في السياق العالمي أيضًا. التحسن في الأداء في هذه الحالة مهم للغاية. أثناء اختبار قياس RULER باستخدام نوافذ سياقية بحجم 32 كيلو بايت، تمكن Engram من الوصول إلى:

- NIAH متعدد الاستعلامات: 97.0 (مقابل 84.2 خط الأساس)

- التتبع المتغير: 89.0 (مقابل 77.0 خط الأساس)

- استخلاص الكلمات الشائعة: 99.6 (مقابل 73.0 خط الأساس)

خاتمة

يكشف إنجرام عن مسارات بحث مثيرة جدًا للاهتمام. هل من الممكن استبدال الوظائف الثابتة بالتجزئة المستفادة؟ ماذا لو كانت الذاكرة ديناميكية ويتم تحديثها في الوقت الفعلي أثناء الاستدلال؟ ماذا ستكون الاستجابة فيما يتعلق بمعالجة السياقات الأكبر؟

يحتوي مستودع Engram الخاص بـ DeepSeek-AI على التفاصيل الفنية الكاملة والتعليمات البرمجية، وقد تم اعتماد الطريقة بالفعل في أنظمة الحياة الواقعية. والخلاصة الرئيسية هي أن تطوير الذكاء الاصطناعي لا يقتصر فقط على نماذج أكبر أو توجيه أفضل. في بعض الأحيان، يكون الأمر عبارة عن بحث عن الأدوات المناسبة للنماذج، وفي بعض الأحيان، تكون تلك الأداة المعينة مجرد نظام ذاكرة فعال للغاية.

الأسئلة المتداولة

ج: Engram عبارة عن وحدة ذاكرة لنماذج اللغة تتيح لها البحث مباشرة عن أنماط الرموز المميزة الشائعة بدلاً من إعادة حسابها في كل مرة. فكر في الأمر على أنه يمنح LLM ذاكرة سريعة وموثوقة إلى جانب قدرته على التفكير.

أ. المحولات التقليدية تحاكي الذاكرة من خلال الحساب. حتى بالنسبة للعبارات الشائعة جدًا، يقوم النموذج بإعادة حساب الأنماط بشكل متكرر. يزيل إنجرام هذا النقص في الكفاءة عن طريق إدخال الذاكرة المشروطة، وتحرير الحساب للاستدلال بدلاً من الاستذكار.

أ. تركز وزارة التربية والتعليم على توجيه العمليات الحسابية بشكل انتقائي. يكمل Engram ذلك عن طريق توجيه الذاكرة بشكل انتقائي. تقرر وزارة التربية أي الخبراء يجب أن يفكروا؛ يقرر Engram الأنماط التي يجب تذكرها واسترجاعها على الفور.

قم بتسجيل الدخول لمواصلة القراءة والاستمتاع بالمحتوى الذي ينظمه الخبراء.

Source link